تقرير “ملفات OpenAI” يجمع أصوات الموظفين السابقين الذين يعبرون عن قلقهم من أن مختبر الذكاء الاصطناعي الأكثر شهرة في العالم يتخلى عن سلامة المستخدمين لصالح الربح. بدأت OpenAI كمبادرة نبيلة تهدف إلى ضمان خدمة الذكاء الاصطناعي للبشرية جمعاء، لكنها الآن تقترب من أن تصبح مجرد عملاق تجاري يسعى لتحقيق أرباح هائلة، متجاهلاً مبادئ السلامة والأخلاق.

وعد OpenAI الأصلي

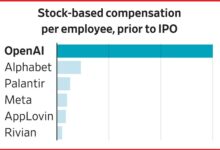

عندما تأسست OpenAI، قدمت وعدًا حاسمًا بتحديد مقدار الربح الذي يمكن أن يحققه المستثمرون. كان هذا ضمانًا قانونيًا بأن الفوائد الكبيرة الناتجة عن تطوير الذكاء الاصطناعي ستعود بالنفع على البشرية، وليس على عدد قليل من المليارديرات. الآن، يبدو أن هذا الوعد على وشك الإلغاء لتلبية رغبات المستثمرين في تحقيق عوائد غير محدودة.

أزمة الثقة

يشعر العديد من هؤلاء الصوتيين بالقلق العميق تجاه الرئيس التنفيذي سام ألتمان. تقارير تشير إلى أن زملاءه في الشركات السابقة حاولوا إزاحته بسبب سلوكهم الذي وصفوه بـ “المضلل والفوضوي”. وقد توصل المؤسس المشارك لـ OpenAI، إيلون سوتسكي، إلى استنتاج مقلق حول قيادة ألتمان للذكاء الاصطناعي العام (AGI).

مكالمات عاجلة لحماية الذكاء الاصطناعي

الموظفون السابقون لا يكتفون بمغادرة الشركة، بل وضعوا خريطة طريق لإعادة OpenAI إلى مسارها الأصلي. يطالبون بإعادة القوة الحقيقية لقلب الشركة غير الربحي مع حق نقض قوي على قرارات السلامة. كما ينادون بقيادة واضحة وصادقة تشمل تحقيقًا شاملاً في سلوك ألتمان.

أهمية المساءلة

يؤكد هؤلاء الموظفون على ضرورة وجود إشراف خارجي مستقل، حتى لا تتمكن OpenAI من تقييم سلامة الذكاء الاصطناعي بنفسها. كما يطالبون بخلق ثقافة تتيح للموظفين التعبير عن مخاوفهم دون الخوف على وظائفهم.

تأتي هذه القضايا في وقت حساس حيث تبني OpenAI تكنولوجيا قد تعيد تشكيل عالمنا بطرق غير متوقعة. السؤال الذي يطرحه الموظفون السابقون هو: من نثق به لبناء مستقبلنا؟ إن الأمر لا يتعلق فقط بالدراما الداخلية في شركة من وادي السيليكون، بل بتأثيرات هذه التكنولوجيا على البشرية جمعاء.

هذا المحتوى تم باستخدام أدوات الذكاء الاصطناعي.